Narrativas sobre inteligencia artificial: percepciones y expectativas

Las historias que (nos) contamos sobre la inteligencia artificial (IA) son los filtros a través de los cuales la interpretamos, proyectando en ella tanto miedos como expectativas. Para comprender su complejidad es necesario quitarnos «las anteojeras» y explorar la IA desde distintas perspectivas culturales y técnicas.

La inteligencia artificial no es solo una tecnología, también es un espejo que refleja nuestras ansiedades, deseos y la esencia de lo que significa ser humano en un mundo cada vez más automatizado. Dejando un poco de lado el funcionamiento de los algoritmos y los modelos generativos, sobrevuela la pregunta: ¿cuáles son las cuestiones relacionadas con la IA que más nos preocupan?

Como la pregunta es amplísima y presenta varias aristas filosas, recurriremos a algunos conceptos que nos pueden ayudar a pensar los conflictos surgidos en nuestras interacciones con la IA.

Algunos de estos conceptos son el valle inquietante de Masahiro Mori, las discontinuidades de Bruce Mazlish, las etapas del duelo de Elizabeth Kübler Ross revisitadas por Benjamin Bratton y la concepción de Yuk Hui sobre el sistema tecnológico gigante que nos envuelve.

A través de estas miradas, podemos llegar a una comprensión más profunda de cómo la IA está transformando nuestra percepción de la inteligencia, la cognición, la tecnología, la propia identidad y el mundo.

El valle inquietante

Imaginemos una película protagonizada por robots que actúan de manera muy tosca, maquinal y donde su carácter artificial está muy marcado. Como espectadores sentimos un distanciamiento de estos artefactos y no nos identificamos con ellos.

En cambio, si miramos una película en la que los robots son indistinguibles de los humanos, entonces sentimos empatía. Los replicantes, androides y cíborgs tienen caras, movimientos y expresiones faciales como los nuestros.

Ahora bien, llega un momento en que estos clones casi perfectos, hechos a nuestra imagen y semejanza, hacen algo que no es exactamente lo que haría un humano, algo que delata la diferencia y entonces comenzamos a sospechar. Dejamos de sentir empatía para experimentar rechazo o incomodidad. Este fenómeno es lo que se conoce como valle inquietante.

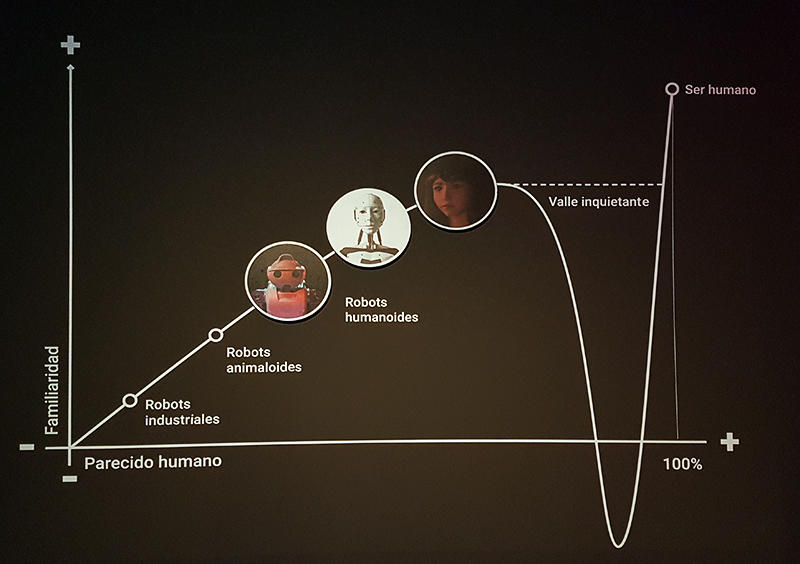

El concepto del valle inquietante recibe este nombre debido a la representación gráfica de la teoría en la que Mori, pionero en robótica, trazó una línea que ilustra cómo varía nuestra empatía hacia los robots o formas humanoides en función de su parecido con los humanos.

Fuente del gráfico: Xataka.com

El gráfico representa una curva en forma de U invertida, donde el punto más bajo o el fondo del valle, corresponde al momento en que el robot o forma humanoide causa el mayor rechazo. Este valle representa la incomodidad emocional que surge cuando se cruza un umbral de similitud, pero no se logra la perfección en la réplica. La incomodidad que sentimos no es nueva, las leyendas y la literatura fantástica desde el Golem hasta la criatura creada por el Dr. Frankenstein, exploran el miedo al ser artificial.

El concepto de valle inquietante se puede entender de varias formas, todas relacionadas con nuestra reacción ante la apariencia de robots y formas artificiales que se parecen mucho a nosotros.

Una explicación es que sentimos un miedo ancestral a crear vida artificial, algo que nuestras creencias más arraigadas relacionan con lo divino. Nos perturba la idea de que algo hecho por nosotros se parezca tanto a lo que consideramos «natural».

Otra explicación es la disonancia cognitiva, esto significa que experimentamos una confusión entre lo que vemos (algo que parece humano) y lo que esperamos que sea (una máquina). Esta confusión nos genera una sensación de rechazo.

También se puede explicar por nuestro instinto de supervivencia: reaccionamos de manera negativa ante algo que percibimos como «defectuoso» o «enfermo», señales que podrían indicar peligro.

Nuestra reacción a la semejanza con lo humano no es sencilla ni directa porque nuestra percepción es compleja y depende de factores como los instintos, el miedo, la confusión, etc.

En su ensayo «La hipótesis del valle inquietante en los robots», Ferran Esteve explica que la experiencia del valle inquietante puede evocar inseguridades y desconfianza hacia las capacidades de las inteligencias artificiales, haciéndonos sentir que pueden usurpar nuestro lugar como seres pensantes únicos.

Imagen de la película Blade runner (1984). Rachel, la replicante, y Deckard, el humano.

La cuarta discontinuidad

En su obra «La cuarta discontinuidad», Bruce Mazlish, que fue historiador y profesor del MIT, se refiere a momentos clave en la historia del pensamiento humano en los que se produjeron cambios radicales en la forma en que nos vemos a nosotros mismos y a nuestra relación con el mundo. Estas discontinuidades, como las llama, son sacudidas que transforman nuestra autopercepción y comprensión del universo.

El ensayo de Mazlish se basa en trabajos de Sigmund Freud en los que el médico y psicoanalista desarrolló la idea de 3 grandes revoluciones del conocimiento que descentraron al ser humano de su lugar de privilegio y le causaron heridas narcisistas o shocks. Estos golpes al ego humano fueron las teorías de Copérnico, de Darwin y del propio Freud.

Mazlish retoma estos 3 descentramientos y argumenta que la humanidad está experimentando un cuarto shock similar a los cimbronazos anteriores. La cuarta discontinuidad permitiría comprender mejor el impacto de las inteligencias artificiales en la autopercepción humana.

- Pimera discontinuidad: este primer cimbronazo ocurre cuando Copérnico, astrónomo y matemático, propone su teoría heliocéntrica. Antes de él, creíamos que la Tierra era el centro del universo y que todo ―incluido el Sol― giraba en torno nuestro. Copérnico demostró que la Tierra es solo un planeta más que orbita alrededor del Sol, lo que supuso un cambio radical en la forma en que entendemos nuestro lugar en el universo. ¡Primera herida a nuestro ego!

- Segunda discontinuidad: el segundo cimbronazo surge con la teoría de la evolución desarrollada por Charles Darwin. Antes de Darwin, se creía que los humanos eran seres superiores de la creación divina mientras que los vegetales y animales eran inferiores. La teoría de Darwin demostró que los humanos evolucionamos a partir de otras formas de vida en procesos que tomaron millones y millones de años. Esta discontinuidad cuestionó la idea de la excepcionalidad humana al dar pruebas de que los animales y nosotros compartimos un ancestro común. ¡Segunda gran herida a nuestro ego!

- Tercera discontinuidad: el tercer cimbronazo se basa en las teorías de Freud sobre el psicoanálisis. Antes de Freud, se creía que los seres humanos éramos seres racionales y conscientes que controlábamos todo lo que ocurría en nuestras mentes. Freud demostró que no tenemos control total sobre nuestra mente y que estamos influenciados por fuerzas inconscientes. Esta discontinuidad dejó en evidencia que no somos tan dueños de nuestros pensamientos y comportamientos como creíamos. ¡Tercera gran herida a nuestro ego!

- Cuarta discontinuidad o la coevolución de hombres y máquinas: el desarrollo de máquinas inteligentes desafía la creencia en la unicidad de la inteligencia y las capacidades humanas. Mazlish sostiene que estamos llegando al punto en que las máquinas podrían alcanzar niveles de inteligencia similares a los humanos, lo que pone en jaque nuestra visión de nosotros mismos. Esta discontinuidad nos invita a reflexionar sobre el papel de la inteligencia artificial en la reconfiguración de nuestra identidad y nuestro futuro. ¡Cuarta gran herida a nuestro ego!

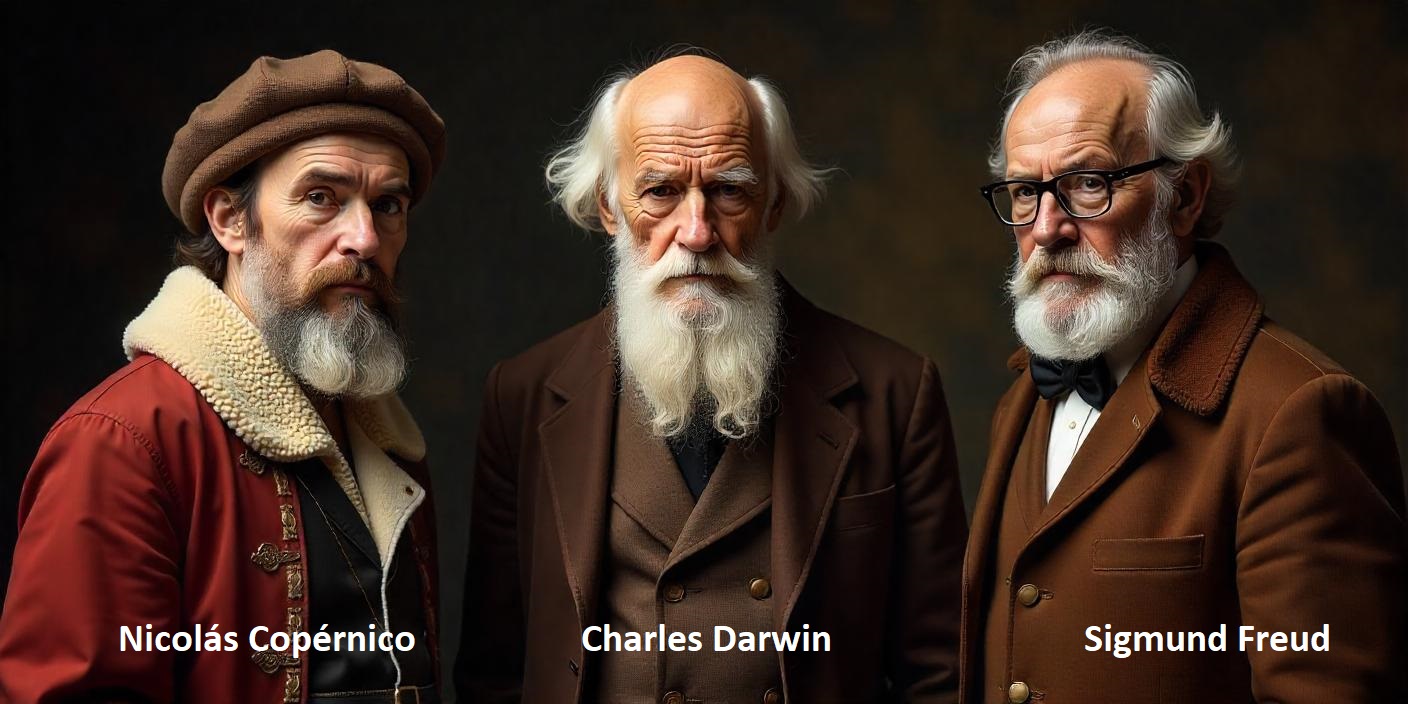

Imagen generada con la IA de freepik.com/

Prompt proporcionado a la IA: fotografía realista de Nicolás Copérnico, Charles Darwin y Sigmund Freud (en ese orden) mirando a cámara. Respetar la vestimenta acorde a la moda de cada época en la que vivieron los tres personajes. Copérnico con vestimenta europea del año 1500, Darwin con vestimenta inglesa del año 1850 y Freud con vestimenta austríaca del año 1900.

Las etapas del duelo frente a la inteligencia artificial

En su ensayo «The Five Stages of AI Grief», Benjamin Bratton, filósofo de la tecnología, utiliza el marco de las cinco etapas del duelo de la psiquiatra suizo-estadounidense Elizabeth Kübler-Ross como una analogía para entender las diferentes respuestas humanas a la inteligencia artificial. Esta perspectiva no solo describe reacciones emocionales, además revela las narrativas subyacentes que construimos para dar sentido a la IA.

Al igual que cuando perdemos a un ser querido, el impacto transformador de la inteligencia artificial nos lleva a través de un proceso de duelo. Hasta ahora vimos las reacciones a ese impacto desde la perspectiva del valle inquietante y también desde la perspectiva de las discontinuidades como heridas, Bratton analiza cómo enfrentamos las consecuencias que nos generan esas heridas a través de las etapas del duelo.

- Negación: esta etapa se caracteriza por la incredulidad ante la realidad de la IA o por minimizar su importancia y sus capacidades. Bratton observa que las narrativas en esta fase suelen argumentar que la IA no es real, que es solo estadística, matemática o una simple herramienta de autocompletado. Esta negación es una forma de protegernos del impacto que la IA puede tener en nuestra visión del mundo y nuestro lugar en él. También puede ser una reacción a las afirmaciones exageradas sobre las capacidades de la IA o una resistencia a aceptar cambios tecnológicos disruptivos. Como señala Bratton, la negación es importante para la comprensión de lo que es y no es la IA.

- Enojo: en esta etapa, la IA es vista como una amenaza existencial, política, cultural y/o económica. Las narrativas en esta fase se centran en la idea de que la IA va a destruir el futuro de la humanidad y representa un ataque a los valores humanos. Bratton explica que el enojo hacia la IA puede ser menos sobre lo que la IA hace y más sobre lo que significa, cómo desafía nuestro statu quo.

- Negociación: aquí la IA es vista como una fuerza poderosa que se puede y se debe controlar mediante la ética, la política y la legislación. Las narrativas de esta etapa buscan establecer marcos de regulación de la IA, asumiendo que los valores humanos son evidentes, detectables y se pueden «computarizar». Esta fase se caracteriza por la esperanza de que, al negociar con la IA, garantizamos su adaptación a nuestras directrices. Bratton critica esta visión, señalando que la IA puede ser mucho más compleja de lo que se reconoce y que la intervención política no siempre es la mejor solución.

- Depresión: en esta etapa, se asume que ya es demasiado tarde para salvar a la humanidad de una crisis existencial causada por la IA. Las narrativas en esta fase son pesimistas y apocalípticas, mostrando que la IA es voraz y que la extinción humana es inevitable. La depresión puede ser tanto un resultado de la desilusión como una forma de enfatizar el poder desmedido de quienes están a cargo de la IA. Bratton señala que la narrativa de una IA desbocada está creciendo en el imaginario y en el discurso popular.

- Aceptación: esta etapa implica reconocer a la IA como un producto de fuerzas evolutivas más profundas que trascienden los marcos históricos convencionales. La aceptación conlleva un cambio de perspectiva, donde la evolución de la inteligencia se entiende como un proceso más amplio que incluye tanto a humanos como a máquinas. Bratton se pregunta si la IA está dentro de la historia humana o si es al revés, haciendo hincapié en que los humanos inventamos las tecnologías y ellas, a su vez, nos transforman de maneras impredecibles. La aceptación se caracteriza por el reconocimiento de que la inteligencia humana no es lo que creíamos, sino algo que se extiende más allá de los individuos.

Bratton también propone una forma de pensar «sin duelo» que supera estas etapas, y aboga por una reconciliación entre la IA y nuevas comprensiones de la vida, la tecnología y la inteligencia. Esta perspectiva no ve la IA como una amenaza, sino como parte de un proceso evolutivo más amplio que también nos incluye.

Imagen: Pixabay.com

Sistema tecnológico gigante

Yuk Hui, filósofo y profesor universitario de Hong Kong, entrevistado por Víctor G. García Castañeda, nos invita a entender que «vivimos dentro de un sistema tecnológico gigante, una red compleja de tecnologías cibernéticas que conforman el mundo en el que habitamos». Así ofrece una nueva perspectiva para ampliar las narrativas sobre la inteligencia artificial como tecnología compleja integrante de un gran entramado o ecosistema con numerosos actores que interactúan. Lo que Flavia Costa llama «mundoambiente».

Este gran sistema tecnológico no es neutral, según Hui está dominado por una lógica capitalista que homogeneiza nuestra relación con la tecnología y nos impone una única visión del mundo a través de narrativas utópicas o distópicas. Para Hui, hay que profundizar en una imaginación tecnológica al margen de esta visión globalizada, buscando narrativas locales arraigadas en las relaciones que cada cultura mantuvo (y mantiene) con sus propios desarrollos tecnológicos.

Hui lo resume en el concepto de cosmotécnica: así como hay muchas cosmogonías y visiones de mundos según los diferentes pueblos, también hay multiplicidad de tecnologías. Cada cultura y sociedad tiene su propia manera de entender, crear y utilizar la tecnología, influenciada por sus valores, creencias y experiencias.

Hacia nuevas formas de narrar

Las narrativas sobre la inteligencia artificial no son objetivas porque reflejan nuestras propias subjetividades, actúan como un espejo de miedos, deseos y expectativas.

Estas narrativas tampoco son neutrales y moldean nuestra percepción de la IA, tanto a nivel individual como cultural. Esto es muy claro en la forma en que nos definimos en relación con las máquinas, como exploró Mazlish, o en las diferentes etapas del duelo por la IA que describe Bratton.

Por su parte, el fenómeno del valle inquietante nos recuerda cómo la semejanza de la inteligencia artificial con lo humano puede generar rechazo, pero también lo importante que es dejar de lado la tendencia a antropomorfizarla.

Tenemos que reconocer que el concepto de inteligencia artificial no es único y se manifiesta de diversas maneras, influenciado por las relaciones que cada cultura construye con sus propios desarrollos tecnológicos, como propone Hui a través de las cosmotécnicas.

Al combinar las perspectivas de Mori, Mazlish, Bratton y Hui, podemos pensar en narrativas alternativas que nos hagan reconsiderar nuestras definiciones tradicionales y comprender que tanto la vida como la inteligencia son procesos complejos en constante evolución.

Bibliografía

Bratton, B. (2024, junio 20). The Five Stages of AI Grief. Noema Magazine.

Esteve, F. (2015, noviembre 11). La hipótesis del valle inquietante en los robots. CCCB LAB.

Freud, S. (n.d.). Una dificultad del psicoanálisis.

Hui, Y. (2024, abril 16). Vivimos dentro de un sistema tecnológico gigante. CCCB LAB. Entrevistado por Víctor G. García Castañeda.

Mazlish, B. (n.d.). The Fourth Discontinuity.

Recomendados

Inteligencia artificial: de la ciencia ficción a la realidad

Texto

Hace apenas unas décadas, las promesas de la inteligencia artificial (IA) parecían circunscriptas a las especulaciones de la ciencia ficción. Hoy, nos encontramos en un mundo donde la rápida evolución de la IA está generando grandes cambios en muchos aspectos de nuestras vidas. ¿Qué es la IA? ¿Cómo funciona? ¿De qué maneras podemos usarla?

Inteligencia artificial: anatomía de un buen «prompt»

Texto

¿Por qué podemos conversar con una inteligencia artificial generativa sin tener conocimientos de programación? Porque la interfaz de la IAGen tiene un diseño muy simple en forma de chat que solo requiere el tipeo de un prompt en un cuadro simple. Una vez tipeado ese prompt, que puede ser una pregunta o una indicación, la IAGen ofrece una respuesta inmediata.

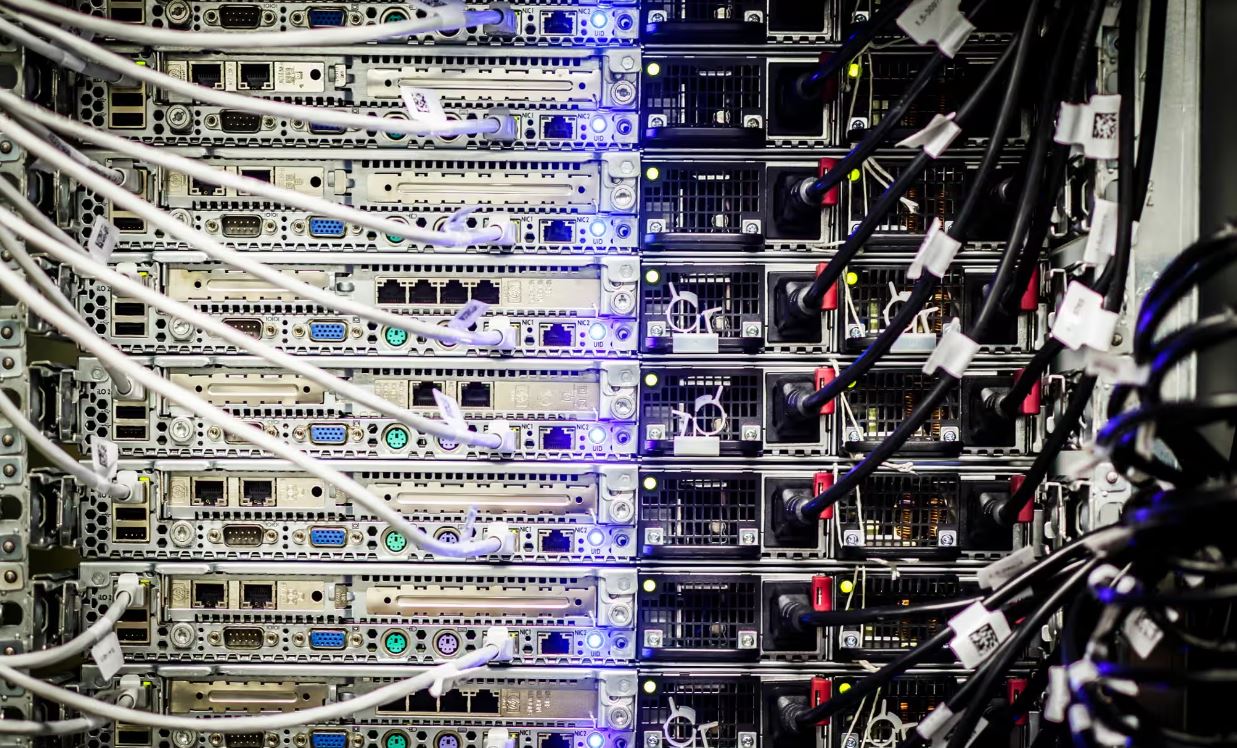

La materialidad de la inteligencia artificial y su costo ambiental

Texto

Detrás de las producciones de los grandes modelos de lenguaje de inteligencia artificial generativa como ChatGPT, Gemini, Copilot, Perplexity y Claude, entre otros, existen enormes infraestructuras materiales que sustentan su funcionamiento y tienen un fuerte impacto en el ambiente.

Sesgos, citas falsas y alucinaciones: fallas en la inteligencia artificial

Texto

La opacidad en el funcionamiento de la inteligencia artificial se debe principalmente a la intención de las empresas desarrolladoras en resguardar los procesos internos de sus algoritmos y no revelar cómo funcionan. Esta falta de transparencia nos pone en alerta y demuestra la necesidad de pensar críticamente en los sesgos, las citas falsas, las alucinaciones y la soberanía tecnológica.

Ficha

Publicado: 23 de diciembre de 2024

Última modificación: 20 de mayo de 2025

Audiencia

General

Área / disciplina

Cultura y Sociedad

Nivel

Secundario

Ciclo Básico

Ciclo Orientado

Superior

Categoría

Artículos

Modalidad

Todas

Formato

Texto

Etiquetas

inteligencia artificial (IA)

Autor/es

Carina Maguregui

Licencia

Creative Commons: Atribución – No Comercial – Compartir Igual (by-nc-sa)